1800亿美元和五层蓝图:Google Cloud要把Agent变成企业操作系统

作者:高飞

2026年4月22日,拉斯维加斯Mandalay Bay。Google Cloud CEO Thomas Kurian在今天Cloud Next大会主舞台的Keynote开场就为当下的AI走势做了一个定性:AI落地已经走过试点阶段,接下来的任务是让AI从个别项目的实验,变成整个企业日常运转的一部分。从我过去一段时间和企业一号位和技术/ 业务负责人的交流,也能印证这个判断,大家谈AI已经从表面的新奇特变成价值端的多快好省。

这场Google Cloud Next信息密度也极高。近二十位高管和客户轮番上台和视频亮相,接近两个小时。

在介绍大会内容之前,我先说三个个人印象最深的记忆点。

第一,投入的量级变了。

Alphabet CEO Sundar Pichai通过视频连线给出了一组坐标:2022年资本支出310亿美元,2026年计划投入1750亿至1850亿美元,四年接近6倍。2026年机器学习计算投入的一半以上将流向云业务。

Pichai同时强调,Google自己就是自家AI产品的第一个用户。75%的新代码由AI生成、工程师审核确认,半年前这个比例还是50%。一次复杂代码迁移中,工程师搭建了一套多角色Agent系统,规划、编排、执行分离,完成速度比一年前快了6倍。营销团队用模型批量生成创意变体,周转提速70%,转化率提升20%。安全运营中心Agent每月自动分类数万份威胁报告,威胁缓解时间缩短90%以上。Pichai的判断是:我们正处在"创新周期中那个凌乱的中间阶段"(messy part of the innovation cycle),基础构件正在汇聚,但仍然混乱。

说到自家AI使用,这场大会本身就是一个AI使用场景。开场前的音乐和屏幕动画,就结合了Gemini的多模态能力,大家可以通过下边这个视频感受一下。

第二,从能力推广到系统工程。

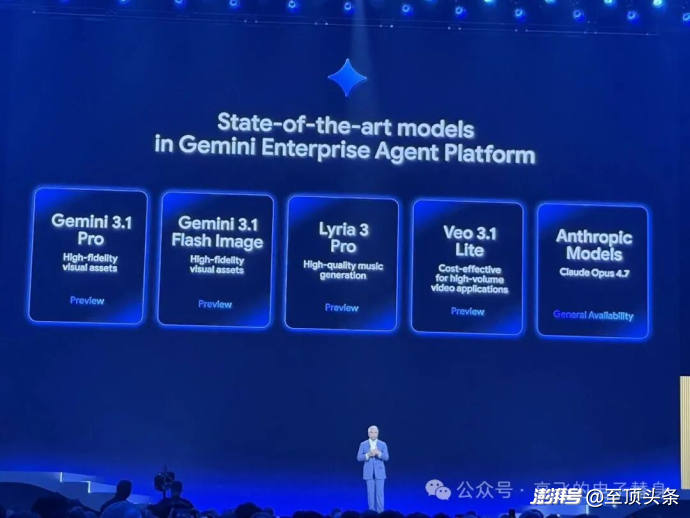

Pichai说,我们的任务已经从"我们能不能构建一个Agent"变成了"我们如何管理数千个Agent"。这可以说是整场Keynote的支点。因为Kurian随后展开了"Agentic Enterprise蓝图"的五层架构体系:AI Hypercomputer、Agentic Data Cloud、Agentic Defense、Gemini Enterprise Agent Platform、Agentic Task Force,从芯片到应用逐层堆叠。

Kurian用了一个公式概括:智能加自动化,必须交付价值。智能来自数据,自动化由Agent驱动。你需要的不是几个聪明的模型,而是一整套集成系统。

第三,蓝图之外的生态版图。

Google Cloud宣布与Apple合作,作为其首选云提供商,基于Gemini技术开发下一代Apple Foundation Models,为更个性化的Siri提供支撑。全球数十亿台苹果设备上的AI能力将部分运行在Google的基础设施上。芯片层面,Google Cloud将成为首批提供NVIDIA Vera Rubin NVL72的云厂商之一。模型层面,平台新增Anthropic Claude Opus 4.7,与自家Gemini 3.1 Pro并行。Gemini Enterprise新增了与Microsoft 365的互操作能力,Canvas中创建的文档和幻灯片可直接导出为Office格式。

所以,我们可以说这是一场Google Cloud的大会,又是一场AI生态的全景展示。

以下沿着五层蓝图,我们逐层拆解介绍(现场纪录,如有疏漏以官方信息为准)。

1. 第一层·AI Hypercomputer:芯片分家,第八代TPU首次为训练和推理各造一颗

Google高级副总裁兼AI与基础设施首席技术官Amin Vahdat登台,用一句话为整个基础设施叙事定调:在Agentic时代,计算不再由单颗芯片定义,计算就是整个数据中心。

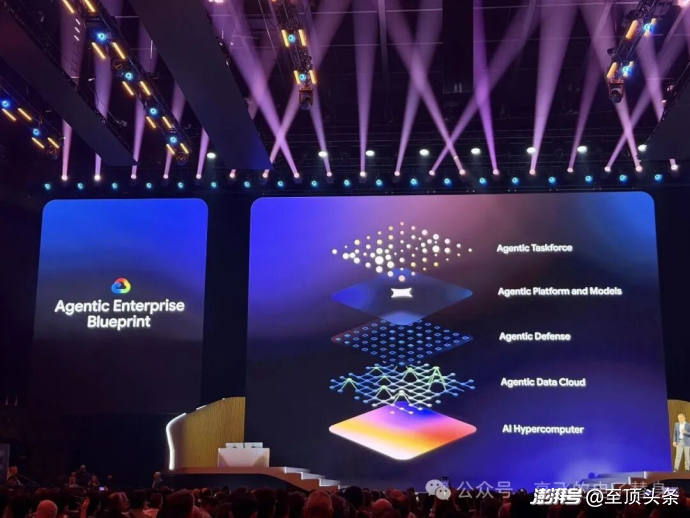

随后他宣布了第八代TPU。十年TPU发展史上,训练和推理首次被拆分为两颗独立芯片。

TPU 8t专为训练而生。核心改进是将块级矩阵乘法移入MXU内部,原生MX量化消除了VPU开销。一个SuperPod可扩展至9600颗TPU,交付121 ExaFLOPS的FP4算力,较上一代Ironwood提升2.8倍。芯片间互连带宽翻倍,采用3D Torus拓扑。每个Pod共享2 PB高带宽内存,Vahdat给了一个直观类比:这相当于将美国国会图书馆全部数字馆藏存储100遍以上。

TPU 8i为推理优化。最核心的变化是集成了专用的Collectives Acceleration Engine,将芯片上延迟额外降低5倍。芯片上缓存完全托管,突破了长上下文解码中的"内存墙"瓶颈。借助新的Boardfly拓扑,1152颗TPU部署在单个Pod中,交付11.6 ExaFLOPS的FP8算力,较256芯片Ironwood Pod性能提升9.8倍。这套架构的设计目标明确:以近零延迟运行数百万并发Agent。

报道指出,Google的训练芯片由Broadcom设计,推理芯片由联发科(MediaTek)设计,Intel、Marvell和台积电参与供应链。DA Davidson分析师曾在2025年9月估算,TPU业务加上Google DeepMind的估值约为9000亿美元。

芯片之外,配套的存储和网络同步升级。Managed Lustre支持高达10 TB/s吞吐量。全新的Virgo Network将134000颗芯片串联,提供47 Pb/s无阻塞带宽,交付170万ExaFLOPS算力。配合Pathways和JAX框架,Google现可在单个集群中利用超过100万颗TPU芯片。Virgo同样适用于NVIDIA Vera Rubin NVL72,支持多达960000颗GPU。Vera Rubin NVL72在Google Cloud上实现10倍性能效率提升,专为高频交互和长上下文工作负载优化。

在通用计算层面,Google Cloud Axion N48计算实例由定制Arm CPU驱动,提供最高2倍性价比和80%更优的每瓦性能。这些实例为Agent提供持续运行的计算底座,消除冷启动延迟和运行间断,确保Agent始终在线待命。

Vahdat还介绍了"自驱动云"的概念:Google使用MCP将每个Google Cloud服务变成Agent可直接编排的工具,并将Gemini推理集成到自身遥测中,系统现在可以执行自主根因分析,在用户意识到有问题之前就识别并修复配置错误。

客户案例从金融到能源、从制造到科研,跨度足够说明这套基础设施的通用性。Citadel Securities,每天交易超过5000亿美元的量化做市商,在TPU Ironwood上将工作负载速度提升2到4倍、成本降低30%。他们的说法简短有力:"钢磨砺钢"(steel sharpens steel)。 过去需要数周的计算,现在可以在数小时甚至数分钟内完成。Axia Energia,巴西最大的电力公司,在TPU集群上运行高级天气建模,提前10天预报恶劣天气条件,主动执行预防措施,逐年显著减少大面积停电。Thinking Machines Labs用Google的NVIDIA基础设施驱动Tinker,一个面向前沿模型强化学习和微调的开放平台。Woven by Toyota将预测复杂交通事件的模型训练速度提升了42%。美国能源部在全部17个国家实验室部署AI Co-Scientist,加速科学发现。Boston Dynamics在用Google Cloud训练和部署视觉-语言模型,在不同工业场景中扩展机器人部署规模。

2. 第二层·Agentic Data Cloud:没有上下文的推理只是猜测

Google Cloud首席产品与商业官Karthik Narain登台时讲了一个有金句质感的观点:"没有上下文的推理只是猜测。当你期望Agent采取行动时,你承担不起猜测的代价。"

围绕"可信上下文"这个核心概念(Narain称之为trusted context,即让Agent确定性地行动的基础),他发布了四项核心创新。

Knowledge Catalog是面向企业的通用上下文引擎。它原生集成BigQuery,将表和元数据映射为统一的业务逻辑。新的Smart Storage能力让图片或PDF一旦进入Google Cloud Storage,就会被即时标记、丰富并准备好供Agent使用,零手动数据工程。由Gemini原生驱动,Knowledge Catalog可以从文件中自主提取实体、映射关系、学习企业特有的业务语义。比如Agent听到"净收入"或"风险"时,它理解的是这家企业自己定义的确切含义。Knowledge Catalog同时提供对Palantir、Salesforce、SAP、ServiceNow、Workday等企业应用的direct zero-copy access,无需数据搬迁即可打通上下文。Narain还宣布Knowledge Catalog与Gemini Enterprise的Deep Research Agent集成,支持在内部数据和网页数据之间执行多步推理,返回附有出处的商业答案。过去需要数周手动调研才能得到的结果,现在一步到位。Virgin Media O2拥有超过20000个数据资产,其中许多从未被利用,Knowledge Catalog正在帮助他们激活这些暗数据。

Data Agent Kit将AI数据科学技能直接集成到开发者已有的工作环境中,无论是VS Code、Claude Code还是Gemini CLI。用户只需声明意图(如"预测客户流失"),环境自主构建管道并在Agentic Data Cloud上部署模型。对Bayer Crop Science来说,手动数据管理和分析流程由此消除,研究人员可以专注于推进可持续农业创新。

Lightning Engine for Apache Spark提供行业领先的Spark性能,性价比是此前市场领导者的2倍。Flipkart、Lowe's和Meesho等公司正在使用。

Cross-Cloud Lakehouse是当天最直接回应多云现实的产品。基于开放的Apache Iceberg标准,分析引擎可以推理任何云中的数据。AWS、Azure或各种SaaS应用中的数据留在原地,Google提供低延迟直连,无需移动数据,不收高额出站费用。Narain一句话收束:"不再需要移动数据,不再有供应商锁定,只有自由。"

Managing Director Yasmeen Ahmad随后用一个食品安全演示将四项创新串联起来。场景是一个虚拟趋势产品"Midnight Swirl冻酸奶"的全球上市评估。演示在五分钟内完成了三个步骤:Knowledge Catalog发现藏在两份独立PDF中的隐蔽大豆过敏原关联;Cross-Cloud Lakehouse零复杂度连接了AWS S3 Iceberg上的忠诚客户列表;Agentic工具在零手动代码下完成了1500万美元的年度预测。Ahmad的金句是:"大多数公司需要五周时间将一个趋势转化为决策。我们用了五分钟。"

客户案例方面:Vodafone在BigQuery上统一数据,启动数百个Agent主动解决网络中断,每年节省数百万美元。Macquarie Bank将客户因诈骗造成的损失减少了一半。American Express在Google Cloud上集中核心数据实现全球规模的欺诈和风险分析。Costco利用BigQuery加速会员洞察。

3. 第三层·Agentic Defense:320亿美元Wiz登场,漏洞利用时间已降至负7天

Google Cloud COO兼安全产品总裁Francis deSouza抛出了两个让人警觉的数字:漏洞的平均利用时间已降至负7天,攻击在补丁发布之前就已经发生;攻击者从首次入侵到将权限转手给下一级威胁团伙,间隔从8小时降至22秒。

Google Cloud的安全叙事有两条线。

第一条线是Gemini原生的Agentic安全运营中心,即Agentic SOC。分类Agent将30分钟的调查缩短为60秒的解决。新的威胁狩猎和检测Agent主动扫描企业环境中的风险,速度和规模都远超人类团队。基于Google的遥测数据,包括Mandiant、VirusTotal和Chrome,集成暗网情报后,可以98%准确率识别外部威胁。CME Group,全球最大的衍生品交易所,依赖这套统一堆栈保护其每天数十亿笔交易。

第二条线是Wiz。这是Google 2026年3月11日以320亿美元完成收购的云安全平台。Wiz联合创始人兼产品副总裁Yinon Costica登台,将Wiz定位为首个"AI应用保护平台"(AI Application Protection Platform,AI-SPP),解决四个关键安全挑战:AI堆栈可见性、主动发现并修复关键风险、从设计之初确保安全、让安全运营团队具备应对新型威胁的能力。

Costica介绍了Wiz的红、蓝、绿Agent体系。Red Agent充当"友好的黑客",持续扫描外部暴露并验证每个风险。演示中它发现了一个身份验证绕过漏洞,攻击者可以借此访问背后的敏感数据库。Green Agent自动化了整个分类过程,从识别所有者、建议修复,到定位最初导致风险的确切代码行,全部自动化,无电话往来。修复方案可以作为PR发送给开发者,也可以交给coding agent自动执行。

演示的完整链条是:Wiz无代理构建动态资产清单→生成安全图谱(Costica称之为一张"活地图",解释AI应用的架构和逻辑)→Red Agent验证风险→Green Agent自动分类并建议修复→将修复推送至开发者或coding agent。deSouza对此收尾的说法是:"我们已经闭合了防御者与构建者之间的循环。"

deSouza还将Shadow AI,即企业中运行但不受控制的未授权模型和Agent,列为当今最大的安全威胁之一。这个判断呼应了贯穿全场的主线:Agent数量爆发之后,管理和安全的复杂性才是真正的瓶颈。

在具体客户层面,Los Angeles Department of Water and Power正在LA28奥运会前借助Google Cloud安全能力保护关键基础设施。新加坡CSIRT通过Google Cloud实现对高级数字威胁的主动防御。DBS银行将Google Cloud安全直接嵌入自身架构,支持实时威胁检测和响应,加固客户信任。Morgan Stanley选择Wiz作为其云安全策略的关键组成部分。从Nestlé到LVMH,从BMW到Shell,全球标志性品牌均依赖Wiz和Google Cloud Security确保其AI驱动的未来安全。

4. 第四层·Gemini Enterprise Agent Platform:从"能不能造一个Agent"到"怎么管数千个Agent"

围绕这个核心转折,Google Cloud发布了Gemini Enterprise Agent Platform,Kurian将其定位为"Agentic Enterprise的任务控制中心"。平台在此前Vertex AI的能力基础上扩展,增加了Agent全生命周期的管理能力。

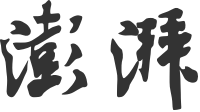

模型层面,当天发布了多款新模型。Gemini 3.1 Pro是最先进的推理模型,针对复杂工作流编排优化,弥合策略与自主执行之间的鸿沟,Databricks、JetBrains和Replit均已选择Gemini 3.1 Pro。Gemini 3.1 Flash Image(又名Nano Banana 2)用于高保真视觉素材生成。Veo 3.1 Lite是成本最优的视频模型,专为高频视频应用设计。Lyria 3 Pro面向企业级音频和音乐。

平台的工具链包含多个层次。Agent Studio支持用自然语言构建和部署Agent。Agent Registry提供单一控制点,索引组织中每个内部Agent和工具。Skills and Tools Registry允许定义模块化指令包,并为每个GCP服务和Workspace服务暴露了相应skill。Agent Marketplace允许直接搜索和部署来自Atlassian、Box、Lovable、Oracle、ServiceNow、Workday等生态伙伴的专业Agent。

一个关键的基础设施决定是:原生集成Model Context Protocol,即MCP,一种让Agent和外部工具标准化对接的开放协议。Google同时将所有GCP服务暴露为MCP服务器。结果是双向打通:任何兼容MCP的Agent都可以与Google Cloud服务交互,Google Cloud的Agent也可以连接任何外部MCP服务器。

安全和编排方面,平台支持Agent-to-Agent编排,允许Agent之间无缝委派任务,同时支持生成式和确定性两种编排模式。合规性要求高的关键工作流中,Agent可以沿着预定义路径执行,确保每次产出可预测的结果。编排流和Agent可以响应四种类型的事件:实时事件、定时事件、触发器事件和批量推理任务。每个Agent拥有唯一的加密身份凭证Agententity,可追踪可审计;通过Agent Gateway集中管理,为组织提供单一命令中心来执行策略。Model Armor在模型和企业数据之间建立防护层,防止敏感数据泄露。Agent Observability提供符合OpenTelemetry标准的遥测数据,可视化任何Agent的完整执行路径。

为了给团队提供持久记忆,Google Cloud还推出了Gemini Enterprise Projects。Projects为Agent提供高保真工作空间,并能使用Deep Think解决最复杂的业务挑战,同时避免上下文污染(context pollution)。这是Agent规模化后的一个核心技术问题:当多个Agent在同一环境中运行,如何确保每个Agent只看到自己应该看到的上下文。

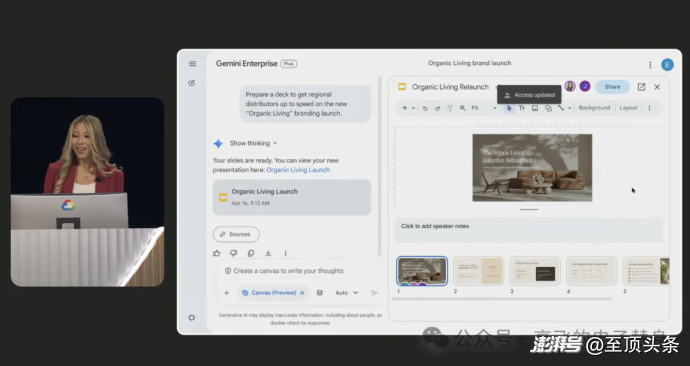

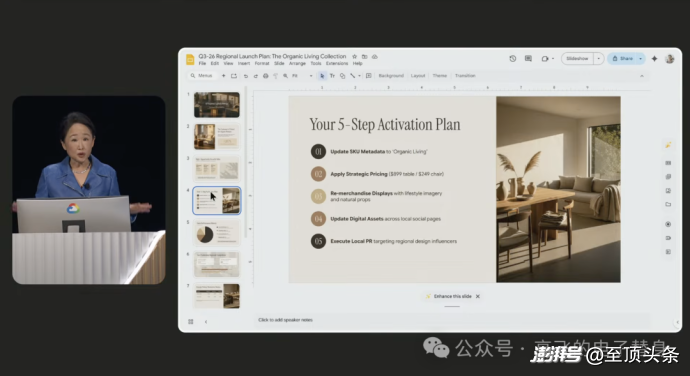

Applied AI前线工程师Erica Chuong的演示将上述能力串在了一起。场景是一家全球家具零售商。用一个提示词,多个Agent在数分钟内完成了:Market Research Agent分析搜索趋势和销售数据、Data Insights Agent连接全球产品目录识别滞销库存、Product Strategy Agent汇总信息并给出重新定价建议。随后Dev Agent直接连接Jira为工程团队创建ticket,门店运营团队通过Gemini Enterprise生成品牌化演示文稿。新的Canvas模式允许直接在Gemini Enterprise中编辑Google Slides,无需切换应用,呼应"消除上下文碎片化"的主题。

5. 第五层·Agentic Task Force与Workspace Intelligence:关掉那15个标签页

五层蓝图的最顶端是面向每一位员工的应用层,一端是预构建的专业化Agent,另一端是让AI融入日常工作流的智能界面。

Google Workspace产品副总裁Yulie Kwon Kim登台时描述了一个每个上班族都能共鸣的场景:"你试图回答一个简单的问题,10分钟后你已经打开了15个标签页。"

她将这称为"上下文税"(context tax),然后宣布了Workspace Intelligence,一个存在于每个Workspace应用中的统一智能层。它利用Gemini的推理能力和嵌入模型,连接Gmail、Docs、Sheets、Slides、Chat中的各种信息节点,消除上下文碎片化。

演示场景中,Kim以区域分销商的身份在Google Chat中操作。通过Ask Gemini,Chat变成了命令中心:Gemini告诉她现在什么最紧急,直接定位到包含所需图表的文档,大海捞针,秒级解决。然后通过标记特定的Regional Campaign Skill,Workspace Intelligence交叉引用邮件、聊天、HubSpot数据和品牌模板,一次性生成了一份完整的Google Slides演示文稿。Kim指着结果说:"看起来像是由创意专家设计的,而不是从终端里出来的。"

新增的Microsoft 365互操作性允许将Canvas中的文档和幻灯片导出为Microsoft Office格式。Kim还宣布,从Microsoft 365迁移到Google Workspace的速度现在最高可快5倍。

客户案例包括:Colgate-Palmolive为34000名员工推出Google Workspace,AI Agent在数分钟内将数据转化为新产品概念,并从积累数十年的销售数据中提取可直接落地的商业洞察。Korean Air全球22000多名员工使用AI Agent加速运营。Natura将数据驱动报告加速10倍。Compass Real Estate用Gemini管理员工日常任务,腾出时间专注高价值客户关系。

在客户体验侧,VP Carrie Tharp介绍了Agentic Task Force,一组预构建的专业化Agent。她将Agent重新定义为"业务的战略延伸"(strategic extension),而非工具。核心产品包括购物Agent、食品订购Agent和客户互动Agent,以及新的全渠道网关Omnichannel Gateway,确保Agent在Web、移动和语音等渠道间保持上下文连贯。

The Home Depot的案例具有标志性意义。其数字Agent"Magic Apron"旨在提供与线下门店"橙色围裙"体验一致的在线服务,覆盖寻路、产品知识、兼容性查询全流程。Home Depot表示,当客户使用Magic Apron时,转化率显著更高。Best Buy也在用Agent Assist引导购物者了解复杂技术参数、解决问题和预约安排,全部自主完成。Papa John's则通过食品订购Agent构建超个性化系统,记住客户偏好以更快地完成配送。

YouTube TV的语音Agent演示更为直观。高级产品经理Patrick Marlow现场拨打了YouTube TV客户支持电话。Agent处理了复杂的产品逻辑,推荐了更便宜的套餐、主动发送注册链接,在用户说"我岳父想了解详情"时自动判断需要切换语言,无缝转入西班牙语对话,准确回答了多屏同时观看的细节。整套体验由YouTube TV客户支持团队在6周内构建完成。Marlow随后在CX Agent Studio中演示了如何用可视化构建器添加新的促销子Agent,几步操作,多Agent系统立即适配。CX Agent Studio还内置了Conversational Insights功能,支持团队在同一平台内直接查看通话表现分析,从构建、部署到迭代优化形成闭环。

Reliance的案例展示了规模:为印度数百万用户部署购物Agent,客户输入"计划一个生日派对",Agent引导跨品类浏览并组装购物车。Gemini驱动的商品信息自动补全能力在数分钟内分析数百万张图片。

Walmart的视频案例传达了一个在零售业极有分量的判断:门店领导通过在卖场出现来建立信任,而不是在办公室对着屏幕。Gemini Enterprise帮助Walmart的门店和供应链领导通过Pixel Fold设备在秒级内获得企业数据答案,让领导去领导,而不是去找数据。

6. 五层贯通:从NASA到Unilever的真实比例尺

五层蓝图的说服力最终要靠客户案例来兑现。整场演讲中穿插了大量案例,几个跨越多层架构的值得单独标注。

NASA Artemis II。 Google Cloud与NASA合作,使用Gemini Enterprise Agent支持Artemis II的飞行准备工作和宇航员安全保障。Kurian特别强调,Artemis II创下了人类航天史上距离地球最远的飞行纪录。

Virgin Voyages。 这家邮轮公司正在用Gemini Enterprise打造"Project Ruby",一个从灵感激发到航行最后一天全程覆盖的个人礼宾Agent。挑战在于船尾没有光纤电缆,Google Distributed Cloud Edge提供了数据弹性,即使离线,智能仍然在线。结果:生产周期缩短60%,月环比销售增长28%,创下季度销售纪录。而Virgin Voyages对Project Ruby的野心不止于海上。他们描述了一个跨品牌贯通的未来:乘客坐Virgin Atlantic航班、住Virgin酒店、登Virgin邮轮,全程由Project Ruby和Gemini Enterprise串联。

Unilever。 这家服务全球37亿人的消费品巨头,通过Gemini Enterprise Agent Platform、ADK和底层Gemini模型构建了竞争性采购多Agent解决方案。这套方案由Unilever内部的Horizon 3 Labs与Google共创,通过单一用户界面编排多个Agent协作。过去需要数天的采购分析和决策,现在在数分钟内完成。

Honeywell用超过100万产品规格训练digital twins,为全球建筑管理生成数十亿条洞察。Liverpool将标志性门店服务搬到线上,预计购物助手的投资回报率可达10倍。ASCO(美国临床肿瘤学会)用Gemini Enterprise让癌症诊疗领域的专业知识更快触达一线医生。Merck将Gemini Enterprise推广至75000名员工,支持其拯救和改善生命的使命。

SIGNALUNA。 这家德国保险公司在数周内达到80%采用率,11000名员工构建专业化Agent。健康Agent自动验证保障范围,推动每周用户数激增400%,回答速度提升37%。Bosch在全球范围内采用Gemini Enterprise,从财务到工程,员工部署定制Agent,腾出更多时间投入复杂研究。KPMG首月即达90%采用率,部署超过100个Agent。

Citi Wealth与Google Cloud及DeepMind合作发布了Citi Sky,一位始终在线的AI驱动财富管理团队成员,支持多种语言。

Shaun White与冬奥。 三届冬奥金牌得主Shaun White登台。Google Cloud展示了与DeepMind合作构建的3D姿态追踪模型,可以从平面2D视频中空间追踪运动员,创建三维姿态,追踪飞行动力学和旋转速度。White对比了自己训练时代的工具,"摄像机和基本上靠猜",感叹这些数据将帮助下一代运动员理解动作背后的物理学。

Kurian在收尾时谈到了开放。

他的说法是:Google Cloud提供的是一个集成的堆栈,但保有选择的自由。我们可以进一步拆成三条:

选择芯片和模型的自由,当天的平台同时提供自研TPU 8和NVIDIA Vera Rubin NVL72,模型层并行支持Gemini 3.1 Pro与Anthropic Claude Opus 4.7;

在数据所在之处运行AI的自由,Cross-Cloud Lakehouse直连AWS和Azure,数据不用搬;

通过治理功能控制自己命运的自由,Agententity、Agent Gateway、Model Armor把管控权交给客户自己的安全团队。合作伙伴方面,Accenture、BCG、Deloitte、McKinsey均宣布扩展Google/Gemini AI实践,AI服务合作伙伴Quantiphi、Distill和Tribe.ai一同加入,帮助ISV和SaaS公司用Gemini Enterprise Agent Platform改造自身解决方案,并将AI能力推向中小企业。