OpenAI的星际之门,就要关上了?

深水研究

DeepWater Research

深度影响决策

文丨陈白

OpenAI,已经很久没有好消息了。

据报道,OpenAI负责星际之门项目的高管Peter Hoeschele已经宣布离职。

而就在同时,媒体爆料OpenAI已经暂停其在英国的Stargate AI基础设施项目,以为潜在的上市做必要的准备。

不仅如此,这一项目还受到潜在的战争威胁。

4月3日,伊朗方面直接放话警告,说美国如果在伊朗境内攻击电力设施,伊朗就会彻底摧毁 OpenAI 在阿联酋的“星际之门 StarGate”计算中心。

去年2025年1月,这项耗资5000亿美元、由OpenAI联合日本软银、甲骨文(Oracle)以及英伟达支持的星际之门计划被誉为是美国AI基础设施的历史性跃进。

如果对星际之门(Stargate)计划没有印象,可以看看我们去年这篇文章(《打开星际之门:5000亿美元投资AI意味着什么》)。但当时文章中的预测是——集中力量办大事式的AI投入,未必能带来想要的结果。

毫无疑问,星际之门作为这一轮人工智能领军者 OpenAI发起的一项全球级的“AI基建”项目,原本被视为全球AI军备竞赛中的终极武器。

然而时至2026年,现实情況却与当初想象的,完全不同。美国的AI大基建计划,好像触碰到了一个无形的天花板。

那么问题是,这个天花板,到底是什么?

01

回看星际之门

回过头看2025年1月宣布的那个气势恢宏的“星际之门”计划,其核心逻辑其实非常简单,也非常熟悉:通过举债和主权财富基金的加持,建设一个耗电量堪比中型城市的数据中心集群。

这是一种典型的“以空间换时间”的基建思维,试图用物理层面的规模优势压倒一切不确定性。所以当时也被视为AI基建的风向标。

但讽刺之处在于,这种模式在美国,似乎从来就行不通。

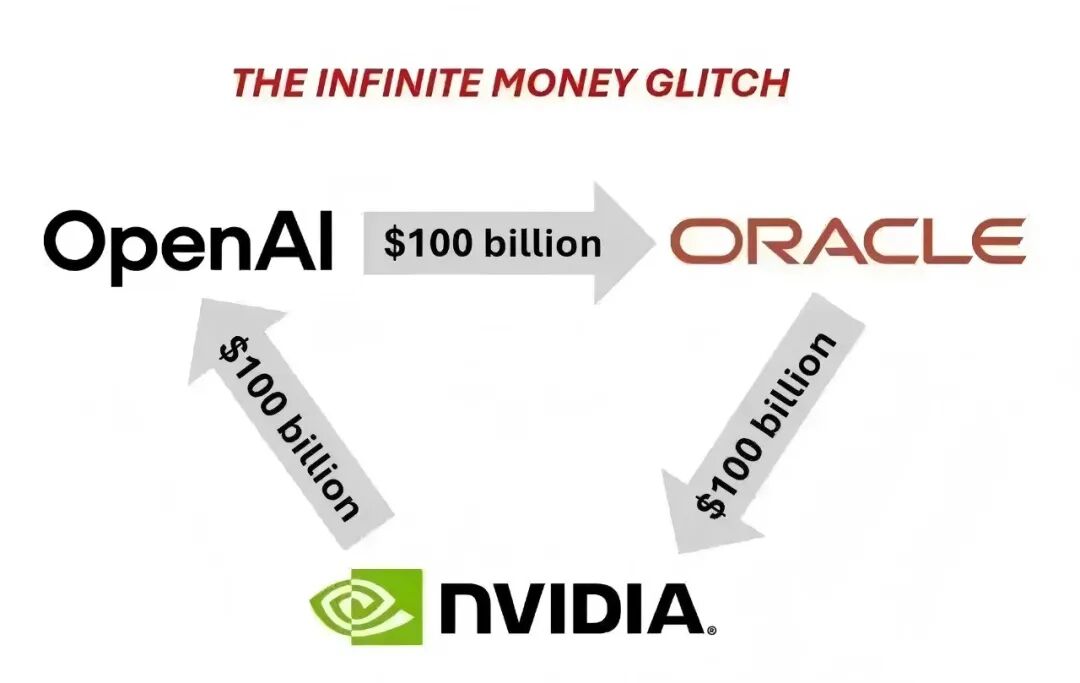

首先是资本逻辑的“左口袋倒右口袋”。看看Stargate的赞助商名单就会发现,背后是一套极其复杂的关联交易网络。

软银需要OpenAI的估值来支撑其愿景基金的报表,甲骨文需要通过提供云基建来获取资本市场的溢价,而OpenAI则需要这些天量资金来购买英伟达的芯片。

但问题是,这种循环往复的资金流动,并没有产生真正的增量价值,而是在AI的幻象下完成了一次财富的重新分配。

现在,OpenAI为了上市不得不缩减Stargate支出时,实际上变相也是在承认,靠财务杠杆撑起来的基建巨兽,在面对公开市场的真实盈亏准则时,是没办法自圆其说的。

更深层的讽刺在于,这种大基建模式原本是美国最为诟病的“计划经济”或“国家资本主义”的变体。

当硅谷的精英们开始谈论5000亿美元的基建计划,谈论政府应该如何配合调动电网、如何简化环评、如何提供补贴时,他们没有意识到,这其实实际上是在要求美国走向它曾经最反对的那条路。

现实证明,这种模式在美国走不通。

美国的电网更新速度跟不上AI数据中心的胃口,美国的监管体系无法为了一个私营公司的“AI梦想”而让路,美国的资本市场最终也会对这种长期见不到现金流回流的“大基建”失去耐心。

Peter Hoeschele的离职和英国项目的暂停,只不过再一次印证了这一点。

换句话说,即便是OpenAI,也无法靠简单地复制“大基建”来强行催生AGI。

星际之门原本被设计成通往未来的门户,现在看起来,更像是一个吞噬现金流的黑洞,在上市前夕,它成了OpenAI财报上最需要被隐去的污点。

02

OpenAI的大跃进

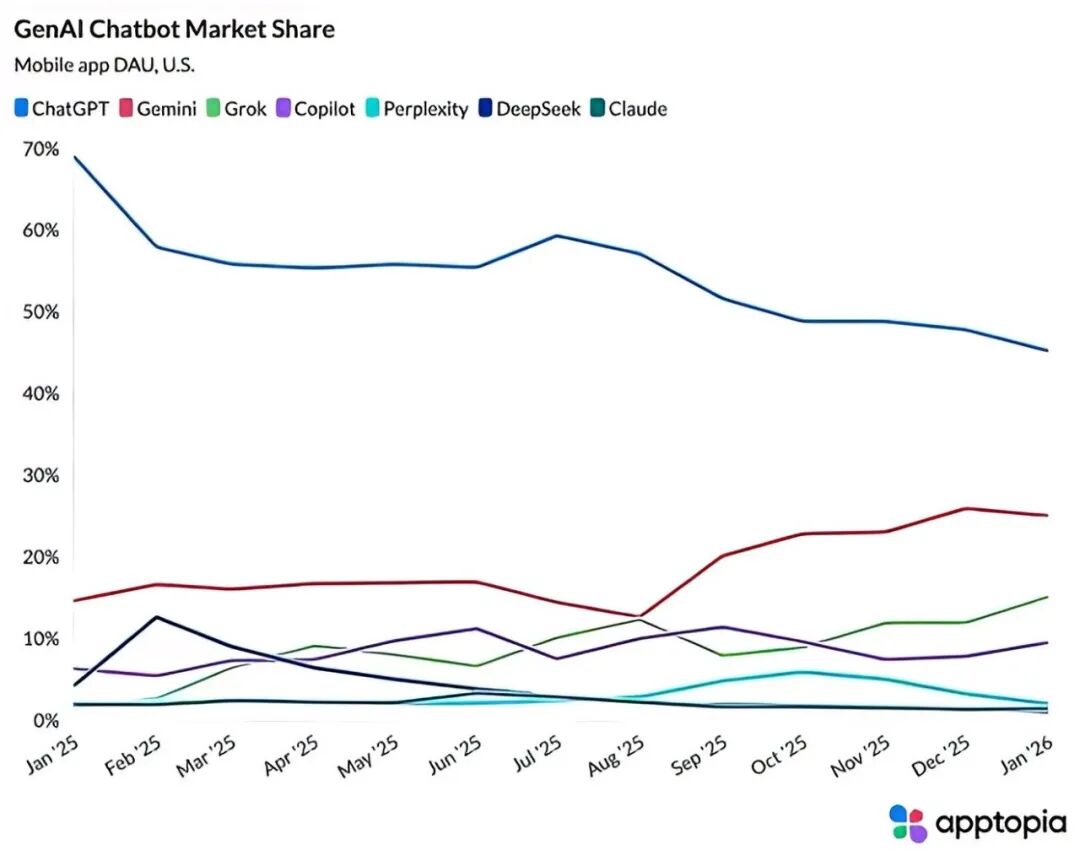

在过去的几年里,OpenAI一直扮演着全球AI产业“唯一灯塔”的角色,但步入2025年之后,这种绝对的统治力正在迅速瓦解。

首当其冲的是其产品力的“掉队”。

回到2024年,GPT几乎是无可争议的行业金标准,但在deepseek之后,神话就已经被打破了(参考《DeepSeek是如何打败中美科技巨头的》)。之后,随着Claude 3.5/4系列的异军突起和谷歌Gemini的厚积薄发,GPT的先发优势已消耗殆尽。

现在,在LMSYS Chatbot Arena这一类权威技术榜单上,ChatGPT的排名屡次被Claude Opus和Gemini Pro反超。

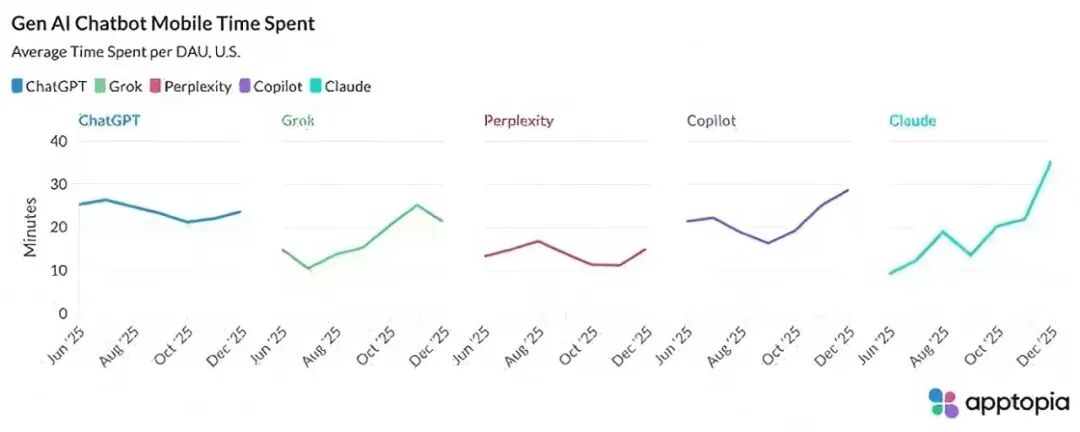

据移动应用数据分析和情报服务公司Apptopia向Big Technology提供的数据显示,在2025年1月至2026年1月期间,Gemini的市场份额从14.7%攀升至25.1%,Grok则从1.6%激增至15.2%。

对于开发者和极客群体而言,GPT不再是那个“不可替代”的选择;相反,在代码生成、逻辑推理以及长文本处理等核心场景中,用户口碑的权杖已经悄然移交到了Anthropic和谷歌手中。

这种技术领先地位的丧失,让OpenAI此前那种依靠“大力出奇迹”建立的增长叙事显得愈发单薄。

伴随着技术光环暗淡的,还有创始人山姆·奥特曼(Sam Altman)个人信誉的崩塌。在过去的一年里,关于奥特曼的“黑料”接连曝出。

从媒体披露的长达数十页的调查报告中,外界看到了一个与公众形象截然不同的奥特曼:他被指控在公司内部实行“家长式”的高压统治,在安全承诺上反复无常,甚至在涉及董事会决策时表现出“习惯性地误导”。

那些曾经由伊利亚·苏茨克维(Ilya Sutskever)等前核心成员留下的内部揭露文件,如同一颗颗定时炸弹,在OpenAI筹备上市的关键节点逐一引爆。

这一场“大跃进”不仅是技术参数上的狂飙,更是一场个人英雄主义的造神运动。

然而,当产品开始平庸化,当“硅谷教父”的道德底色被拆穿,OpenAI此前那种近乎宗教式的吸金能力正在遭遇前所未有的质疑。

支撑“星际之门”计划的不再是坚不可摧的技术信仰,而更像是一种被资本裹挟、不得不继续向前冲的惯性。

03

伟大,不能被计划

所以,科技的问题其实往往从来就不是科技问题,而是需要站在更高的维度来思考。

比如在OpenAI身上,就涉及到一个更深层次的问题:科技创新的跃迁,到底能不能通过这种顶层设计式的“大计划”来实现?

回望历史,美国AI乃至整个IT产业的领先,从来就不是源于某种耗资千亿的宏大蓝图,而是源于自由市场中无数次偶然、零散、甚至带有盲目性的创新实验。

OpenAI前研究员肯尼斯·斯坦利(Kenneth Stanley)在他的著作《为什么伟大不能被计划》(Why Greatness Cannot Be Planned)中,其实已经很明白的讲清楚了这个道理。

他认为,真正的突破往往来自于那些并没有明确目标、仅仅是因为好奇而进行的“寻宝之旅”。如果一个人过早地设定了宏大的目标(比如非要造出一扇通往AGI的星际之门),他就会被这个目标所束缚,从而忽略掉那些真正能通往未来的微小路径。

今天的OpenAI,似乎正走在斯坦利所警示的反面。

OpenAI正在从一个灵动的实验室变成一个背负着千亿基建重担、必须定期向华尔街展示进度的庞然大物时,它的创新灵魂可能已经开始枯萎。所以我们看到,越来越多的知名研究员,选择了离开。

而如果OpenAI剩下的只有一个被精心计划出来的AGI,那么它大概率很可能只是一个更庞大、更烧钱的概率模型,而不是真正的智能觉醒。

美国AI的优势,在于其生态的无目的性和多样性,但“星际之门”计划想做的,却是试图将所有的资源和注意力引向一条极其单一、极度耗能的重资产路径。

这种模式,几乎不像是AI时代的产物,而是一种工业时代的思维惯性。

所以,对于OpenAI来说,真正的考验并不在于它的模型能力,而在于这家曾经的创业公司的创新能力被系统性的质疑。

从这个角度来说,OpenAI上市的那一刻,极有可能是这一轮AI泡沫从狂热走向理性的关键转折点。

END

排版运营|洋洋

欢迎分享与评论