人工智能正在使人类的表达和思维同质化 | Cell Press科学新闻

生命科学

Life science

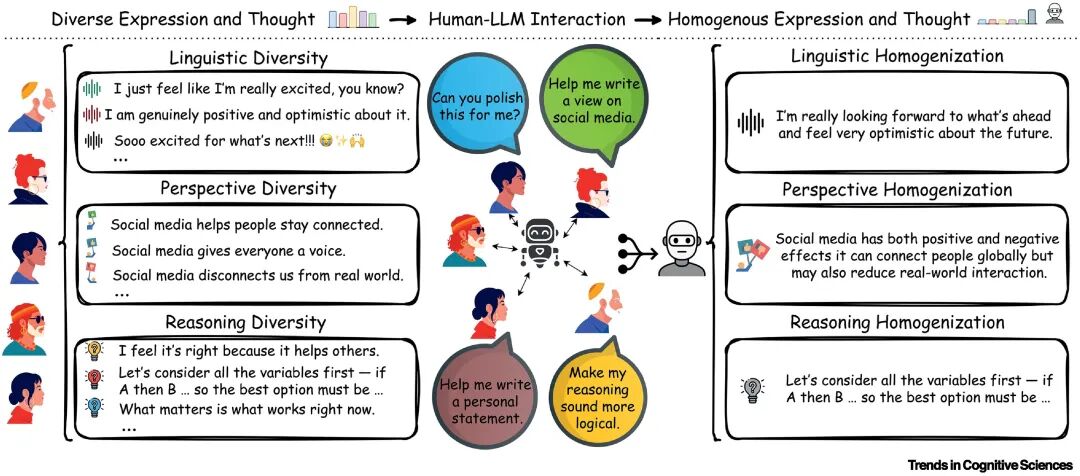

人工智能正在让人们的说话、写作和思考方式变得“标准化”。计算机科学家和心理学家在一篇观点论文中指出,如果这种同质化继续不受控制地发展,有可能削弱人类社会的智慧和适应能力。3月12日,该论文发表在Cell Press细胞出版社旗下期刊Trends in Cognitive Sciences上。专家认为,人工智能开发者应该将更多真实世界的多样性纳入大型语言模型(LLM)的训练数据集,这不仅有助于保护人类认知多样性,还能提升机器人的推理能力。

“每个人的写作方式、推理过程和世界观本就存在差异。”该论文的第一作者、美国南加州大学计算机科学家Zhivar Sourati表示,“当这些差异通过相同的LLM来处理时,人们独特的语言风格、视角和推理策略就会被同质化,从而在不同用户之间产生标准化的表达和思维。”

▲长按图片识别二维码阅读原文

研究人员表示,在群体和社会中,认知多样性能够增强创造力和解决问题的能力。然而,随着数十亿人越来越多地使用同样的少数几款人工智能聊天机器人来完成各种任务,认知多样性正在全球范围内缩减。例如,当人们使用人工智能来润色文章时,最终的作品会失去个人风格上的独特性,人们对自己创作成果的创意所有权和拥有感也会降低。

“令人担忧的不仅仅是LLM塑造了人们的写作或说话方式,而是它们正在悄然重新定义什么才算是可信的言论、正确的观点,甚至是好的推理。”Sourati说。

研究人员引用了多项研究,这些研究表明,LLM输出的多样性低于人们撰写的文本,且LLM输出往往反映西方、受过教育、工业化、富裕和民主社会的语言范式、价值观和推理风格等。

“由于LLM被训练来捕捉和重现训练数据中的统计规律,而这些数据往往过度代表主流语言和意识形态,因此它们的输出常常反映出人类经验中狭隘而有偏见的部分。”Sourati说。

研究人员指出,尽管研究表明个体在使用LLM时往往能产生更多、更详细的想法,但当群体使用LLM时,产生的想法比他们单纯依靠集体力量时更少、创意性也更低。

“即使人们不是LLM的直接用户,LLM仍会以间接方式影响他们。”Sourati说,“如果我周围的很多人都以某种特定的方式思考和说话,而我的做法不同,我会感到压力,然后去与他们保持一致,因为这看起来是一种更可信或更社会可接受的表达方式。”

除了语言之外,研究表明,在与带有偏见的LLM互动后,人们的观点会变得与该LLM更加相似。LLM还偏爱线性推理模式,例如思维链推理,这种模式要求模型展示逐步推理的过程。研究人员表示,这减少了直觉式或抽象推理风格的使用,而这些有时比线性推理更高效。他们还指出,LLM可以改变人们的预期,从而微妙地改变一个人工作的方向。

“用户往往不是主动引导生成内容,而是顺从模型的建议,选择那些看起来‘足够好’的选项,这逐渐将主动权从用户转移到了模型身上。”Sourati说。

研究人员表示,人工智能开发者应该有意识地将语言、视角和推理方面的多样性纳入他们的模型中。他们强调,这种多样性应该立足于真实存在的多样性,而不是引入随机变异。

“如果LLM能够以更多样化的方式来处理想法和解决问题,它们就能更好地支持我们社会的集体智慧和解决问题的能力。”Sourati说,“我们需要使AI模型本身多样化,同时调整我们与它们的交互方式,尤其考虑到它们在各种任务和场景中的广泛使用,以此来保护后代的认知多样性和创意潜能。”

▌论文标题:

The homogenizing effect of large language models on human expression and thought

▌论文网址:

https://www.sciencedirect.com/science/article/pii/S1364661326000033

▌DOI:

https://doi.org/10.1016/j.tics.2026.01.003

原标题:《人工智能正在使人类的表达和思维同质化 | Cell Press科学新闻》