“简历筛选未通过”——被代码影响的职业轨迹

是算法在淘汰?

还是观念在淘汰?

今年42岁,拥有10年互联网大厂工作经验的张女士在投递200余份简历均石沉大海后,尝试将简历中的毕业时间模糊处理、姓名改为中性化的“张立”,两周内便收到了6个面试邀约。这样的简历“优化”策略,揭开了招聘平台黑箱算法的冰山一角。

简历”消失“的背后:被算法改写的求职命运

当张女士仍在等待心仪岗位面试通知时,同方向的另一位资历较浅的男性竞争者已相较轻松地获得了面试邀请。这样的情况并非个例。在当今数字化招聘的时代,算法筛选系统已经成为企业初筛简历的首道关卡,却在不经意之间,成为了女性和年长求职者的隐形屏障。

2022年北京大学针对“中国招聘算法歧视”的研究报告表示,部分招聘平台的AI模型会因简历中出现 “女性”“45岁”“退休返聘” 等词降低简历通过的概率。实验显示,隐藏年龄和性别信息后,中高龄求职者的面试率提升了20%。

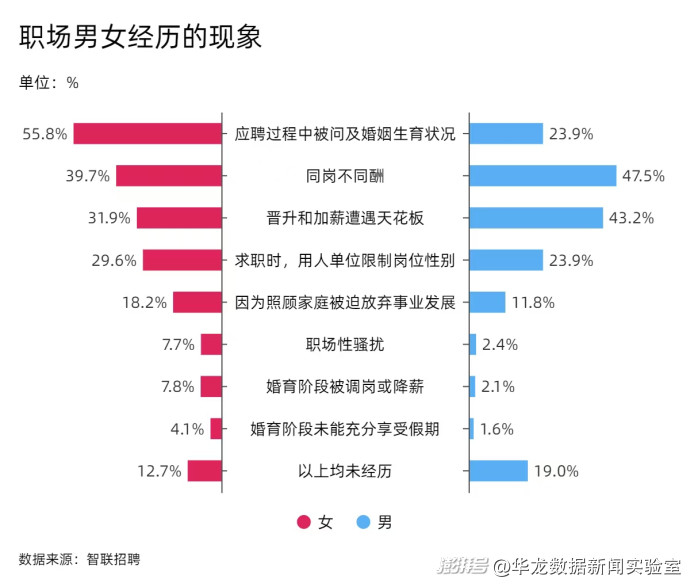

算法的歧视是隐形的,而职场中的区别对待却显然呈现着。智联招聘发布的《2021中国女性职场现状调查报告》中发现,约 55.8%的女性在求职时被问及婚育状况,而男性仅 23.9%,甚至不到女性的一半。此外,29.6%的女性在求职时因为性别原因受到用人单位的限制。以上的数据,男性比例均低于女性,女性在职场中受到明显的“性别限制”。

这一情况在2023中并未迎来改变。据智联招聘调查报告显示,61.2%的女性在求职中被问婚育,不仅高于上一年的58%,还远高于男性的32.3%。不仅如此,38.3%的女性表示婚育影响职场前景,远高于男性的17.9%。数据显示,11.9%的女性因性别升职加薪不顺,高于男性的10.3%。这意味着,和职场男性相比,婚育、性别问题歧视持续甚至加深,为女性的职场发展带来困扰。

不仅女性,年长求职者同样面临这类问题。

2023年复旦大学《中国就业市场性别与年龄歧视研究》在招聘平台投递测试简历,发现当女性简历含“45岁”时,被查看率下降 70%。

这种种数据的背后,不仅仅是无数求职者被改写的职业命运,还是社会歧视含沙射影的体现。在算法的世界里,他们的经验、能力和潜力被简化成了数字与标签,而那些与传统优势群体不符的特征,却成为了被“过滤”的理由。

技术黑箱:从“数据推断”到决策黑箱的闭环

算法的“黑箱”特性,使得其决策过程难以被外界理解。以常见的机器学习算法为例,它通过对大量历史数据的学习,建立起一套预测模型。在招聘场景中,算法会分析过往成功入职者的简历特征,比如学历、工作经验、技能证书等等,然后根据这些特征来判断新求职者与相对职业的匹配度。

(此图为AI智能简历筛选系统流程图)

然而这种看似科学的推断过程,却隐藏着巨大的风险。一方面,历史数据本身就可能存在偏见。例如,如果一家企业过去在招聘中存在对女性或年长求职者的歧视,那么这些带有偏见的数据就会被学习甚至放大。欧盟基本权利署在《2023年人工智能与就业歧视白皮书》报告就指出,在68%使用AI招聘算法的企业中,有34%的算法被检测出存在性别或年龄偏见。

但其实,算法的核心机制歧视就是对“非显示数据”的标签化捕捉。比如通过姓名库(如“张伟”“王芳”等高频性别指向姓名)、身份证号前6位(推断地域与年龄)、教育经历时间线(如“2005年本科毕业”推算年龄约40岁)等间接信息,便可为简历自动生成“性别概率值”“年龄分段标签”。

而在中国信息通信研究院2023年对10家招聘平台的监测显示,7家平台存在“性别-岗位类型关联加权”,如销售岗对男性简历的匹配度默认提升20%-30%。这也揭示了平台算法常基于企业历史招聘数据训练,会形成“隐性偏好模型”,会自动为同类岗位生成“优先匹配年轻男性”的比例规则。

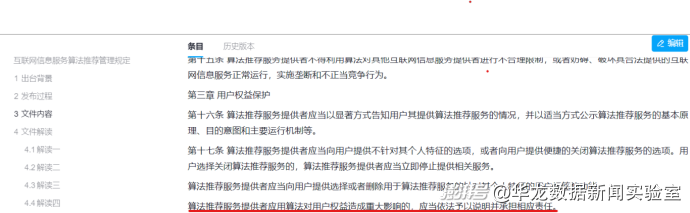

另一方面,算法的决策过程缺乏透明度。即使求职者对筛选结果提出质疑,企业也往往难以给出明确的解释,因为算法的决策是基于复杂的数学模型和大量的数据运算,连开发者有时候也难以完全理解其背后的逻辑。这种“黑箱”决策不仅剥夺了求职者的知情权和申诉权,也使得算法歧视难以被发现和纠正。

对此,腾讯研究院秘书长张钦坤表示,如果不解决这两个问题,不仅影响用户对AI应用的信任,而且也可能会带来算法歧视、算法安全和算法责任等方面的相关问题。而数据工程师也意识到需要在算法的可解释性和高效率之间做出取舍,目前还没有两全其美的 AI 算法,如何做好 AI 可解释的量化呈现是当前业界需要思考的重点。

算法偏见的本质:社会镜像的技术投射

算法并非天生带有偏见,他只是社会现实的一种反映。社会对女性和年长求职者的传统观念,如认为女性在职业发展中会受到生育等因素的限制,年长求职者缺乏创新能力和学习能力等,早以深深的烙印在历史数据和社会文化中。当算法以这些数据为基础进行训练时,就不可避免地将这些偏见融入到了决策模型中。

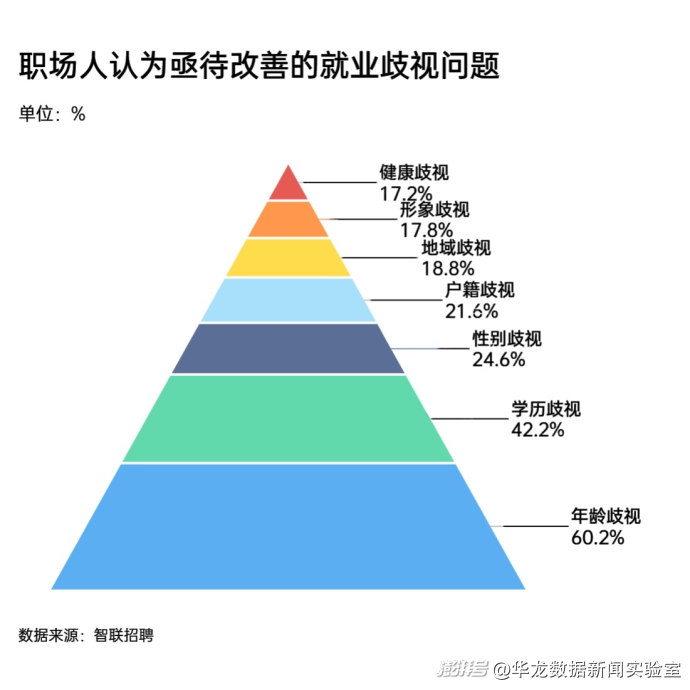

智联招聘《2023 年一季度人才市场热点快报》中进一步指出了年龄歧视是劳动权益的“头号克星”,职场人认为有待改善的就业歧视问题中,年龄歧视占比高达60.2%。

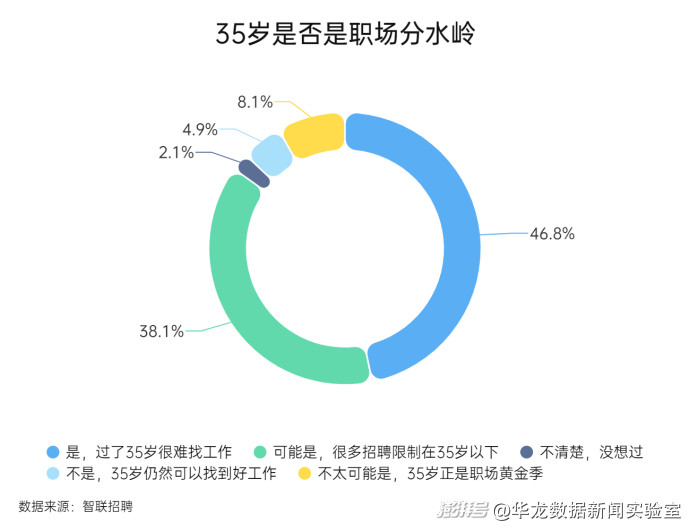

报告通过大规模调研数据还指出,85% 的白领认为存在 “35 岁门槛”,其中 46.8% 的受访者直言 “过了 35 岁的确很难找工作”;38.1%表示目前许多公务员招聘年龄也以35岁为限,35岁可能是职场分水岭。

此外,女性求职者和年长求职者还有一个共同面临的问题:即使真的面试上并且找到工作后,在行业区分、职级分布上也存在着一定的歧视。

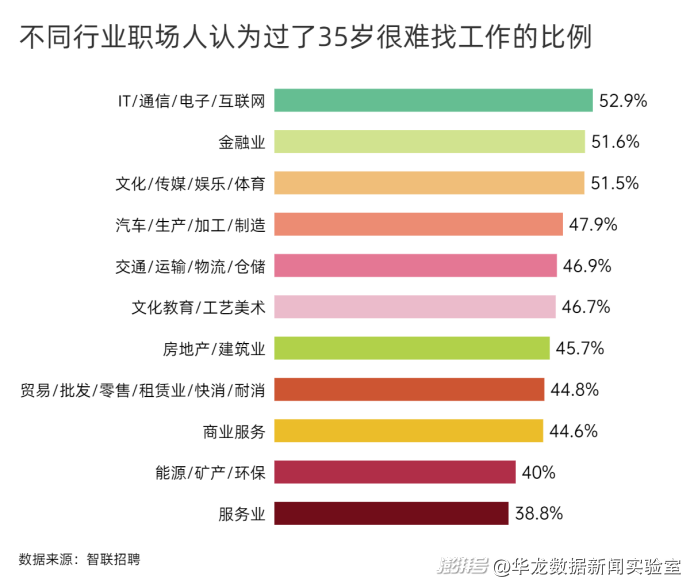

该报告还阐述了,从行业上看,互联网、IT、通信、电子等行业对年龄的要求会更高一些,金融、文化艺术等行业紧随其后,以至于找工作时,年龄成为了求职者的求职负担。由于互联网、金融行业竞争较为激烈,因此这类行业的求职者更容易产生年龄危机。

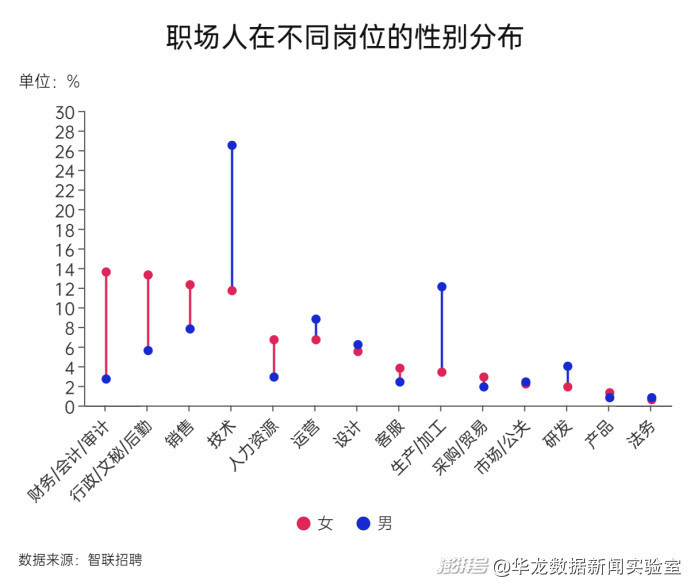

智联招聘CEO郭盛在《2021中国女性职场现状调查报告》指出,女性工资低于男性,除了管理层占比偏低,还在于女性主要从事的岗位为社会认同的基础岗位,从本次调研数据来看,女性主要分布在财务、行政、人力资源和销售岗,现在普遍高薪高社会地位的技术、产品岗位上男性的占比优势较为明显,这也影响女性的平均工资水平。

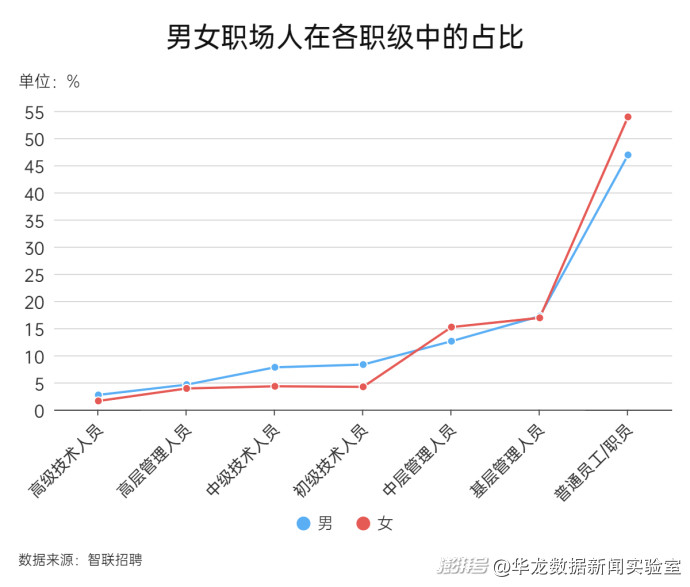

报告还显示,男性职场人有46.9%处于普通员工层次,而53.9%的女性职场人都在担任基础岗位,女性占比是超越男性的。在不同级别的技术人员中,女性仍为“第二性”,占比与男性差距明显。这些数据说明,在市场环境里,不仅默认女性的技术水平低于男性,而且在中高级别、中高层次领域,男性地位还是高于女性,并且拥有更多的话语权。

这种技术偏见的危害是深远的。它不仅限制了女性和年长求职者的职业发展,也剥夺了企业获得多元化人才的机会,阻碍了社会的创新与进步。正如哈佛大学教授凯西·奥尼尔在《算法霸权》一书中所写到的:“算法是一种权力工具,它可以放大社会的不平等,而不是消除它们。”

破局困境:当法律困境撞上社会偏见磐石

面对算法歧视问题单纯的技术调整显然不足以解决根本问题。虽然一些企业尝试通过优化算法、增加数据多样性等方式来减少偏见,但这些“技术补丁”往往治标不治本。

2023年欧盟《人工智能法案》第52条(透明度义务)已要求招聘类AI系统披露“是否基于性别、年龄等敏感特征决策”,提供通俗易懂的算法影响说明(如“您的简历因年龄标签被降低通过率”)。德国西门子随机剔除算法中“45岁以上简历降权”参数,使该群体简历通过率提升了37%。但慕尼黑工业大学2024年追踪研究发现,尽管显性年龄过滤规则被删除,算法对“2000年前毕业”等间接年龄线索的识别仍使中老年求职者面试率比青年低22%。

这种“规则删除但偏见依存”的现象,印证了算法歧视本质上就是社会年龄焦虑的的技术折射——当法兰克福证券交易所的企业普遍把35岁设为“管理岗准入红线”,算法即使剔除显性标签,也难以阻断HR在面试环节对“年长=保守”的潜意识联想。

2019年加拿大《就业公平法》修订后,多伦多银行因无法证明算法公平性,向127名被筛除的女性求职者赔偿210万加元,推动温哥华证交所300强企业中89%引入算法审计。但加拿大统计局2023年数据显示,金融行业女性高管占比仅从21%升至25%,技术岗位女性工程师比例甚至下降3个百分点。

这种矛盾在多伦多证券交易所的交易大厅尤为明显——即便算法删除了性别加权参数,交易员群体中女性占比仍不足15%,而年薪超50万加元的岗位中男性占比达87%。

从欧盟的《人工智能法案》到加拿大的《就业公平法》,这些破局尝试都指向了一个共同核心矛盾:算法并非技术故障,而是AI对社会结构性歧视的数字化呈现。破局之路远非修改代码或者修订法律那般简单,当社会评价系统仍将“年轻”“男性”与“高潜力”天然绑定,即便算法成为“色盲”,职场歧视也会以“文化适配”“潜力评估”等更隐蔽的方式存在。正如中国人民大学商法研究所所长刘俊海指出:“算法治理的核心,是打破‘社会偏见→数据污染→算法强化→歧视固化’的恶性循环”。

要打破这一困境,我们需要的不仅“数据去标识化”“算法审计”等技术补丁,更要重构职场评价体系——让能力而非年龄、让价值而非性别,成为衡量求职者的核心标准。技术只是工具,偏见审视才是核心目标。让技术真正服务于人的尊严与公平,让每一个求职者都能在平等的基础上展现自己的能力和价值。这条路任重道远,但一刻也不容缓。

参考资料:

[1]北京大学(2022)《中国招聘算法歧视研究报告》

[2]智联招聘《2021中国女性职场现状调查报告》

[3]智联招聘《2023年中国职场性别现状调查报告》

[4]复旦大学(2023)《中国就业市场性别与年龄歧视研究》

[5]欧盟基本权利署《2023年人工智能与就业歧视白皮书》

[6]北京大学(2023)《招聘算法透明度研究报告》

[7]中国信息通信研究院(2023)《互联网招聘算法合规性评估报告》

[8]智联招聘《2023年一季度人才市场热点快报》

[9]欧盟《人工智能法案》(2023)

[10]西门子2024年年报

[11]慕尼黑工业大学(2024)《算法偏见的隐形迁移》

[12]加拿大(2019)《就业公平法》

[13]加拿大统计局(2023)《性别与职场平等报告》

[14]联合国《2024年人工智能与性别平等报告》

作者|潘晶晶 何紫菱 耿静娴

指导老师|高殿洪 钟俊辉

编辑|何紫菱