南昌大学宋贤林副教授、硕士生董嘉庆为文章共同第一作者,刘且根教授为通讯作者。

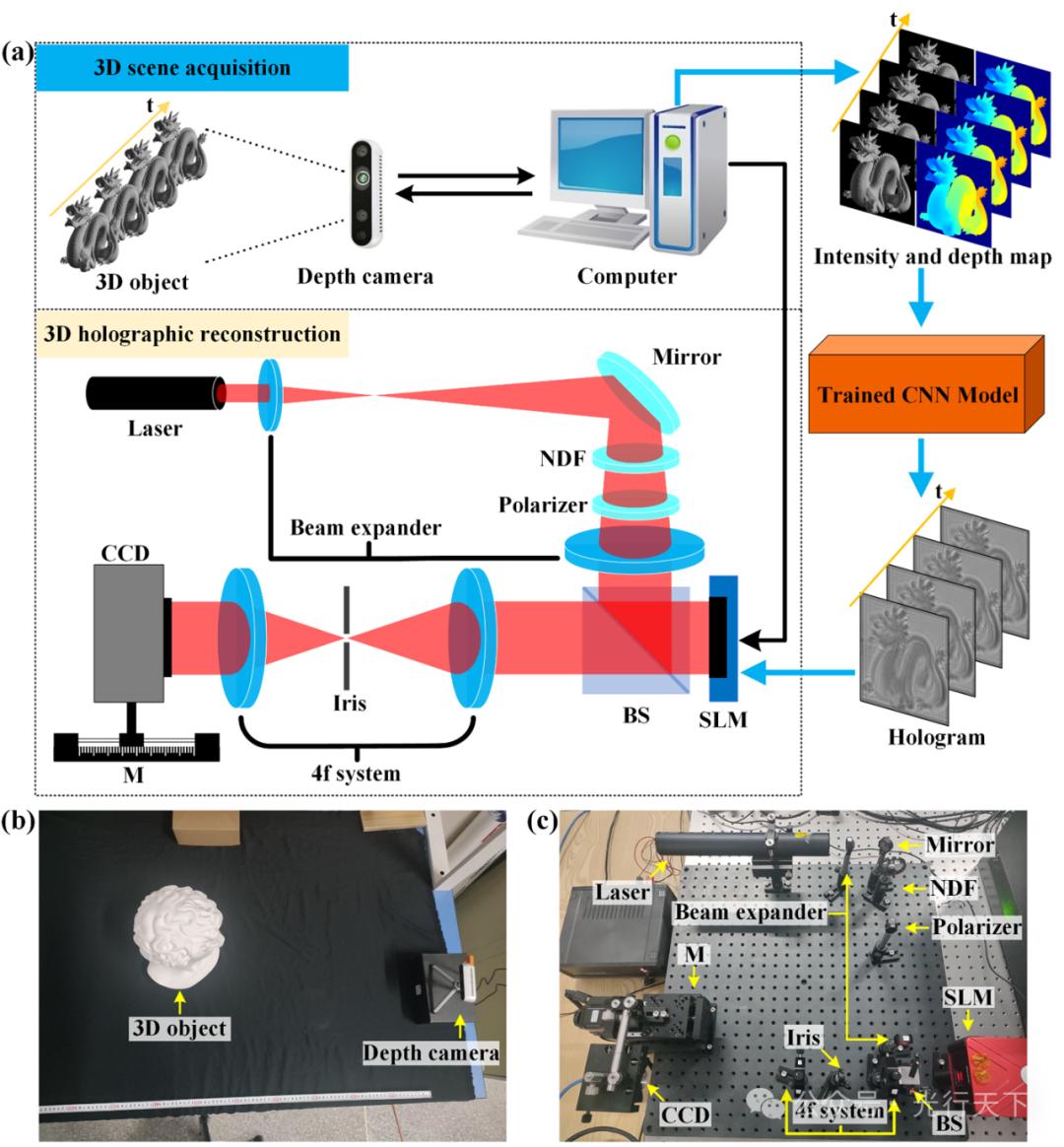

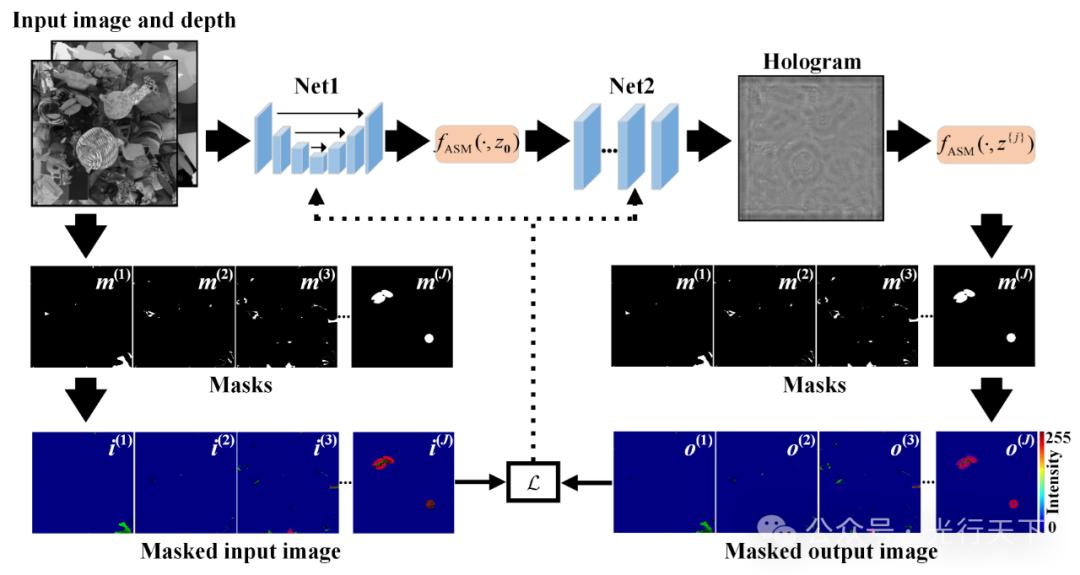

所提卷积神经网络的训练流程图如图2所示。训练过程中,网络输入包含三维场景信息的强度图和深度图到Net1进行编码,Net1由Unet架构实现并输出目标振幅和相位场。使用角谱算法将目标振幅和相位场向前传播z0,得到全息平面的振幅和相位场。之后,将全息平面的振幅和相位场输入Net2并生成全息图,Net2由一个全卷积残差网络实现。使用角谱算法将全息图随机重建到三维物体的一层,计算并最小化重建图像与目标图像的损失。通过反向传播更新Net1和Net2的参数。训练中使用了由均方误差损失和感知损失组成的复合损失函数。

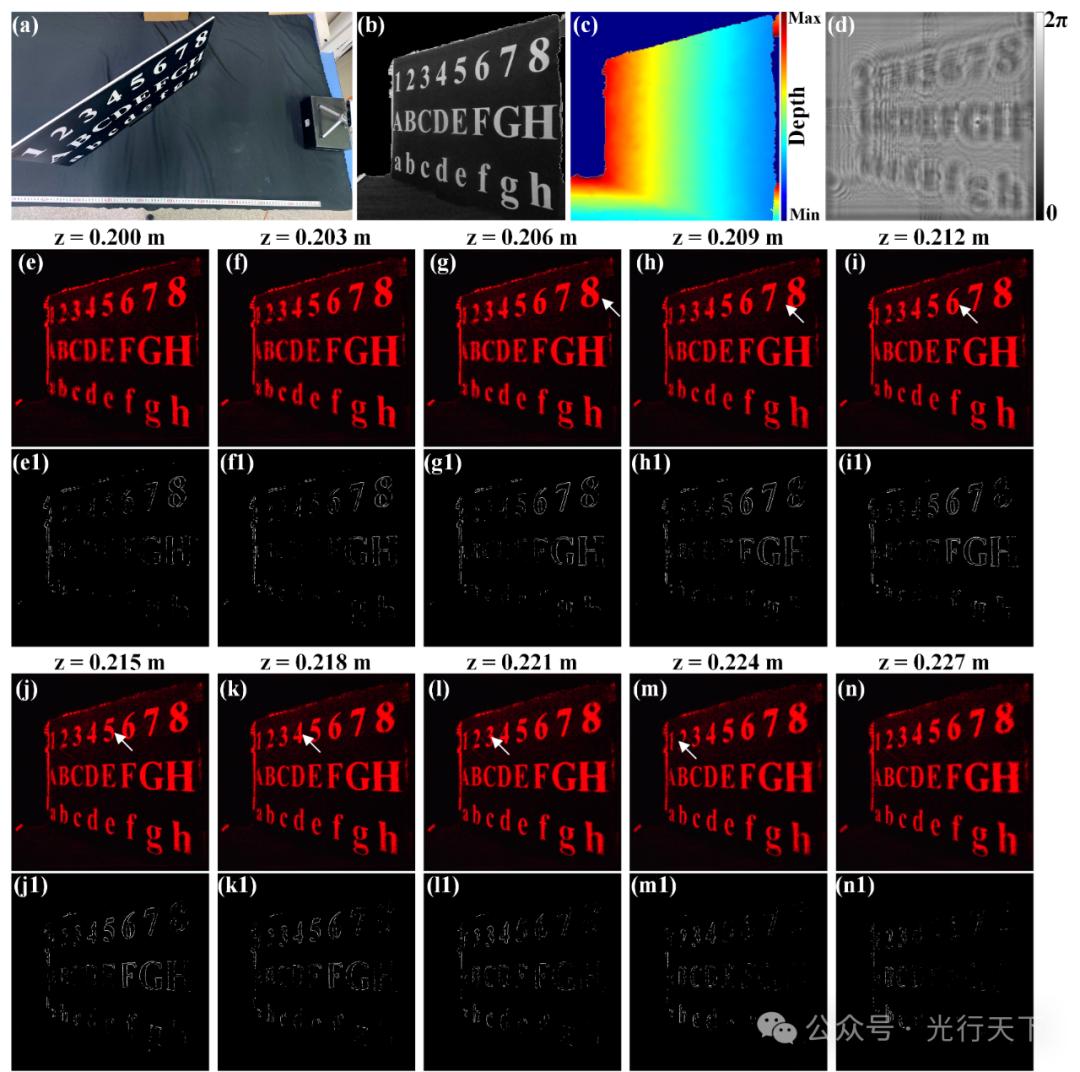

研究团队进行了数值模拟和光学实验,以验证所提方法的有效性。图3为三维实景采集与数值重建结果。可以观察到,随着重建深度增大,重建图像的在焦区域由三维物体的近端向远端移动,当重建距离为0.209 m时,数字“8”聚焦清晰,而数字“1”模糊。当重建距离为0.227 m时,数字“1”聚焦清晰,而数字“8”模糊。

图4为三维实景采集与光学重建结果。可以看到,三维物体的细节得到了很好的重建,在焦区域附近可以观察到相对清晰的画面,光学重建结果和数值重建结果较吻合。为了更加直观地展示重建图像的在焦区域随重建深度的变化,使用Tenengrad算子提取重建图像的在焦区域如图4(e1)-(n1)所示。随着重建距离的增大,提取出的在焦区域逐渐由三维物体的近端向远端移动。实验结果证明了所提方法对于不同深度物体的重建能力。

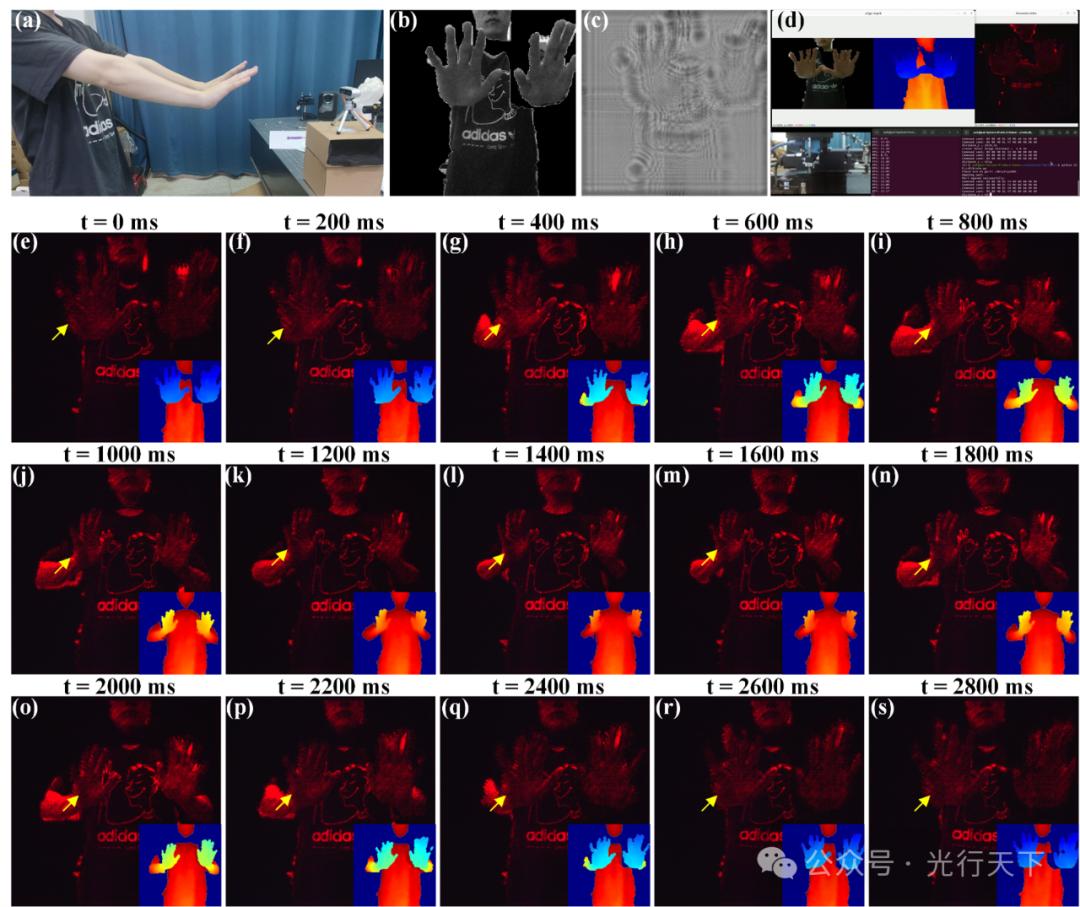

研究团队进一步验证了所提系统对运动的人体的三维采集与重建效果如图5所示。CCD相机拍摄三维场景远端的全息重建图像。可以看到由于人体躯干部分位于远端并保持不动,因此人的衣服的图案始终清晰。在t = 0 ms时,人的手部距离深度相机较近,图5(e)中黄色箭头指示的手部呈现出离焦模糊的效果。随着手部逐渐远离深度相机,手部的全息重建图像逐渐清晰。在t = 1400 ms时,手部移动到最远端,手部的全息重建图像呈现出最清晰的效果。从t = 1600 ms开始,手部开始接近相机,随着时间的推移,手部的全息重建图像逐渐模糊。

链接

论文链接:Real-time intelligent 3D holographic photography for real-world scenarios (optica.org)代码链接:https

原标题:《南昌大学在智能三维全息摄影方面获得新进展》