萧箫 发自 凹非寺

量子位 | 公众号 QbitAI

大语言模型用着爽,但推理速度实在太慢了?

而且,增加模型体积,推理效果也并不一定就比之前更好。

为了解决这一问题,谷歌MIT的研究人员提出了一个新框架CALM,让它自己来决定计算量。

如果CALM意识到某些层“可有可无”,那么它在计算时就会跳过这些层。

论文被po到网上后,立刻火了一波:

CALM全称Confident Adaptive Language Modeling,即置信自适应大语言模型。

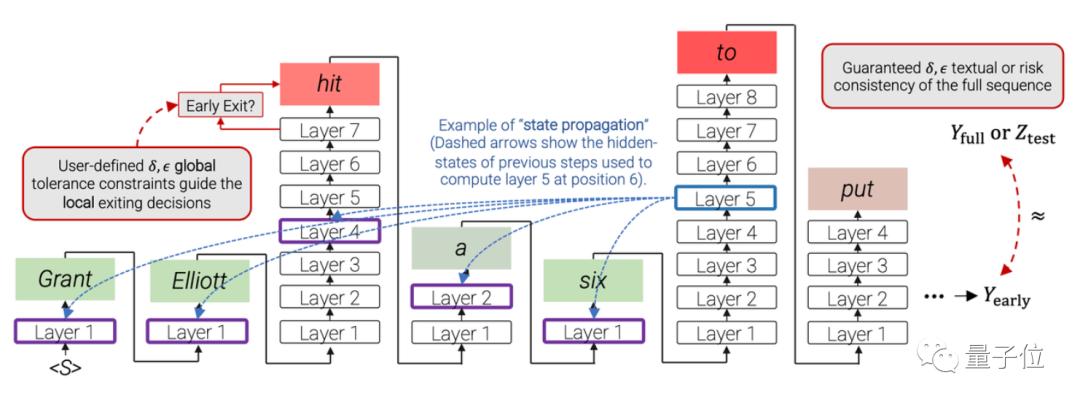

这一模型基于Transformer架构,为了加速它的计算,研究人员提出了一个名叫“提前退出”(early exiting)的方法,让模型根据不同的输入,动态决定要用多少层网络来计算。

也就是说,在计算的过程中,模型不需要经过每一层计算再输出结果,而是能直接用中间层的特征输出token,从而降低模型计算量。

这就需要训练模型学会自己判断了。

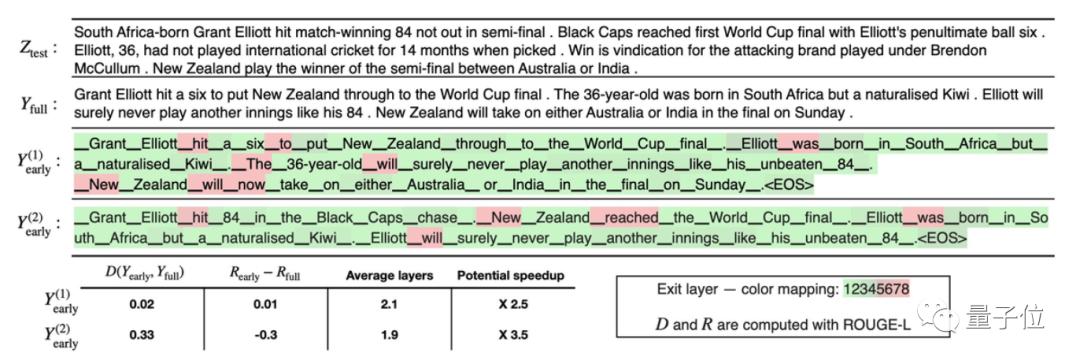

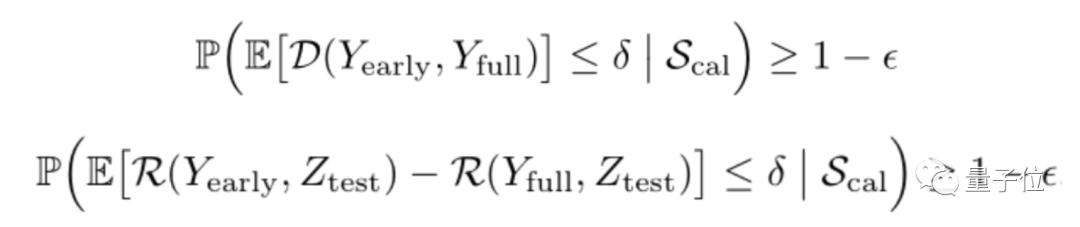

其中,Yfull是标准模型输出的结果,Yearly是模型“提前退出”时输出的结果。为了让Yearly的效果更好,就需要尽可能让它与Yfull保持一致。

因此作者们也在论文中给出了两个不同的公式,可根据实际情况选用:

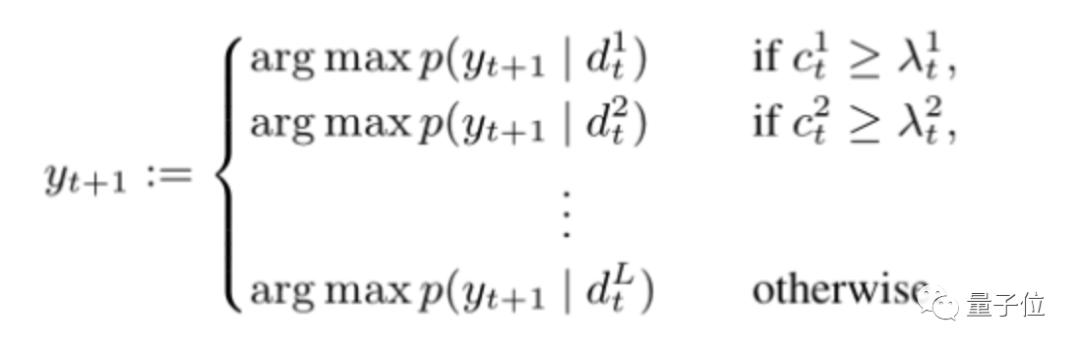

模型在解码过程中,会计算每一层的置信度c,并将它与达到“提前退出”的阈值λ相比,如果c大于λ,则模型“提前退出”。

归纳翻译QA任务表现都不错

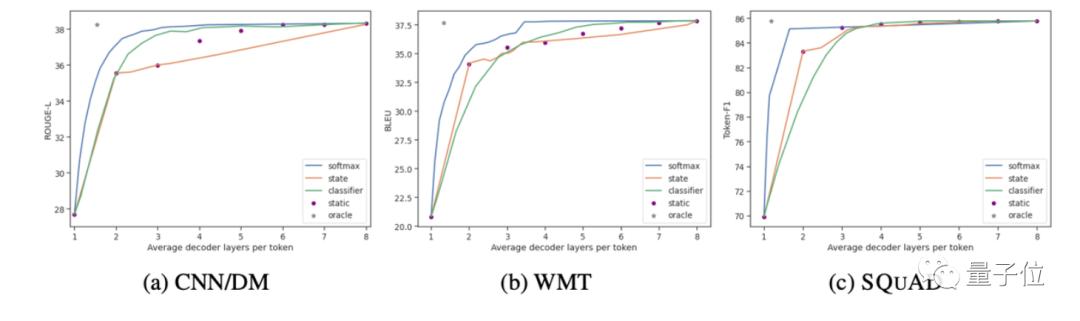

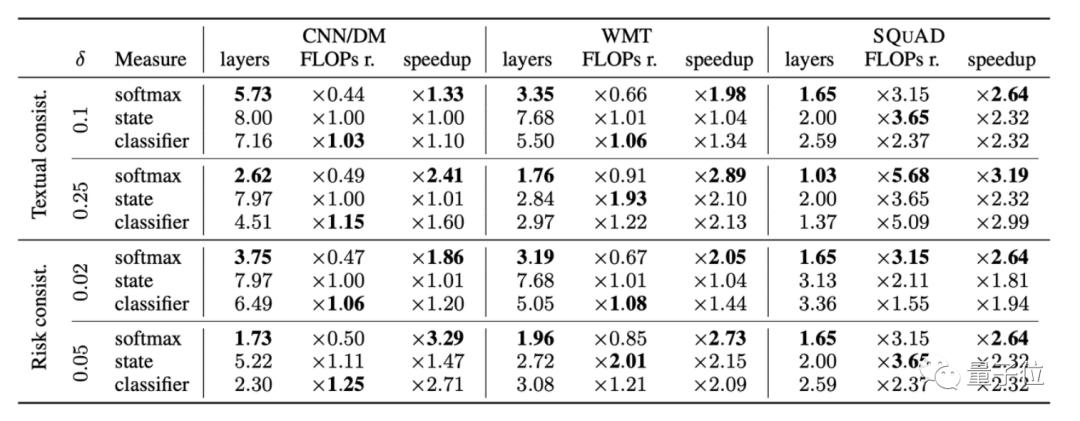

论文在CNN/DM、WMT和SQuAD三个数据集上进行了测试。

这篇论文的作者一共有8个人,分别来自谷歌和MIT CSAIL,其中主要负责人有两位,Tal Schuster和Adam Fisch。

论文地址:

https://arxiv.org/abs/2207.07061

参考链接:

https://twitter.com/TalSchuster/status/1547966142412513282

— 完 —

原标题:《教大模型自己跳过“无用”层,推理速度×3性能不变,谷歌MIT这个新方法火了》